Die Tools der künstlichen Intelligenz, mit denen man sich ohne Zustimmung ausziehen kann, wurden speziell für Frauen entwickelt. Diese Nackt-Deepfakes wirken bei Männern nicht.

Die Manipulation von Bildern und Videos zur Erstellung sexuell orientierter Inhalte gilt in allen Ländern der Europäischen Union eher als Straftat.

Die erste Richtlinie zu Gewalt gegen Frauen wird im April 2024 ihre endgültige Genehmigungsphase durchlaufen.

Durch Programme der künstlichen Intelligenz werden diese Bilder manipuliert, um Frauen ohne ihre Zustimmung auszuziehen.

Doch was ändert sich mit dieser neuen Richtlinie? Und was passiert, wenn in der Europäischen Union lebende Frauen Opfer von Manipulationen in Ländern außerhalb der Europäischen Union werden?

Die Opfer

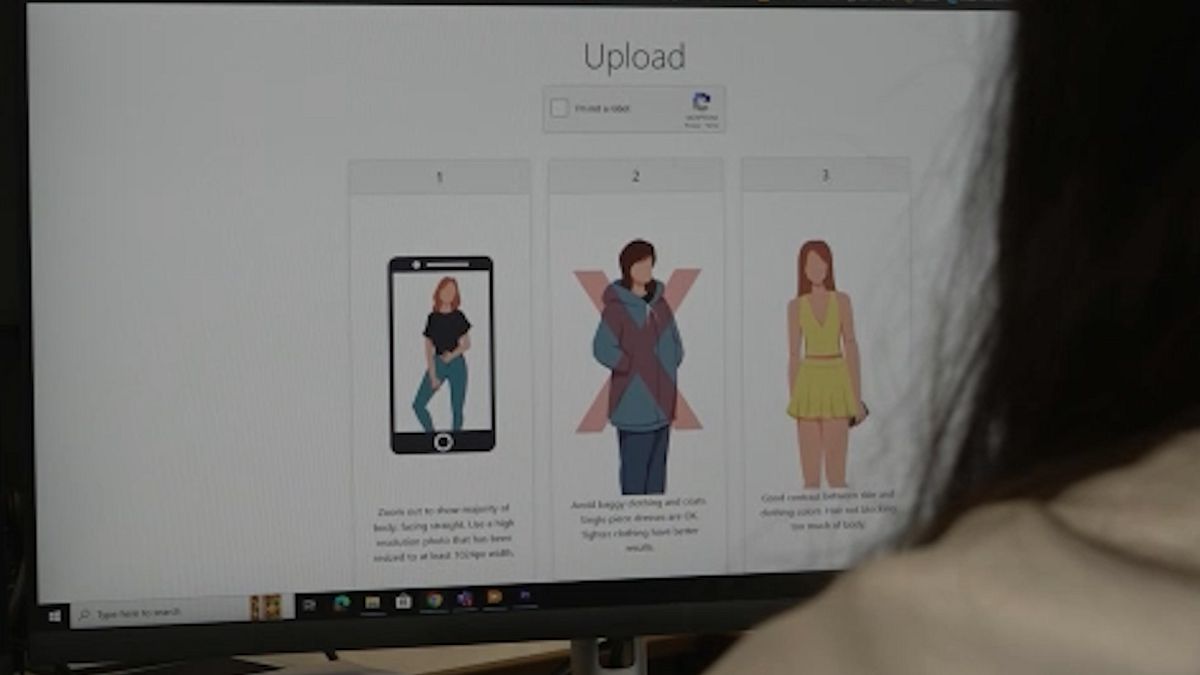

Websites, die die Erstellung sexueller Deepfakes ermöglichen, sind in jeder Suchmaschine nur einen Klick entfernt und kostenlos.

Laut der State of Deepfakes-Studie von 2023 dauert die Erstellung eines sexuellen Deepfakes weniger als 25 Minuten und kostet nichts, da nur ein Foto verwendet wird, auf dem das Gesicht deutlich zu erkennen ist.

In der Stichprobe von mehr als 95.000 Deepfake-Videos, die zwischen 2019 und 2023 analysiert wurden, zeigt die Studie, dass es einen Anstieg um 550 % gab.

Laut Henry Ajder, einem KI- und Deepfakes-Experten, zielen diejenigen, die diese Stripping-Tools verwenden, darauf ab, „zu diffamieren, zu demütigen, zu traumatisieren und in einigen Fällen sexuelle Befriedigung zu erreichen“.

Die Ersteller von Nackt-Deepfakes suchen „überall und überall“ nach den Fotos ihrer Opfer.

„Es könnte von Ihrem Instagram-Konto, Ihrem Facebook-Konto, Ihrem WhatsApp-Profilbild stammen“, sagt Amanda Manyame, Beraterin für digitales Recht und Rechte bei Equality Now.

Verhütung

Wenn Frauen auf nackte Deepfakes von sich stoßen, stellen sich Fragen zur Prävention.

Laut einem Cybersicherheitsexperten liegt die Antwort jedoch nicht in der Prävention, sondern in schnellen Maßnahmen zu ihrer Beseitigung.

„Ich sehe diesen Trend, aber es ist wie ein natürlicher Trend, wann immer etwas Digitales passiert, bei dem die Leute sagen, stellen Sie keine Bilder von Ihnen online, aber wenn Sie die Idee weiter vorantreiben wollen, heißt das: Lassen Sie es bleiben.“ auf der Straße, weil man einen Unfall haben kann“, erklärt Rayna Stamboliyska.

„Leider kann Ihnen Cybersicherheit hier nicht viel weiterhelfen, denn es geht nur darum, das Verbreitungsnetzwerk abzubauen und diese Inhalte vollständig zu entfernen“, fügt der Cybersicherheitsexperte hinzu.

Derzeit stützen sich Opfer von Nackt-Deepfakes auf eine Reihe von Gesetzen wie das Datenschutzgesetz der Europäischen Union, die Datenschutz-Grundverordnung und nationale Verleumdungsgesetze, um sich zu schützen.

Bei einer solchen Straftat wird den Opfern empfohlen, einen Screenshot oder eine Videoaufzeichnung des Inhalts anzufertigen und diesen als Beweismittel zu verwenden, um ihn der Social-Media-Plattform selbst und der Polizei zu melden.

Der Berater für digitales Recht und Rechte bei Equality Now fügt hinzu: „Es gibt auch eine Plattform namens StopNCII (Stop Non-Consensual Abuse of Private Images), auf der Sie ein Bild von sich selbst melden können und die Website dann einen sogenannten „Hash“ erstellt. des Inhalts. Und dann wird KI verwendet, um den Inhalt automatisch auf mehreren Plattformen zu entfernen.“

Globaler Trend

Mit dieser vorgeschlagenen neuen Richtlinie zur Bekämpfung von Gewalt gegen Frauen werden alle 27 Mitgliedsstaaten über die gleichen Gesetze verfügen, um die unterschiedlichsten Formen von Cyber-Gewalt wie sexuell eindeutige „Deepfakes“ zu kriminalisieren.

Allerdings kann die Meldung dieser Art von Straftat ein komplizierter Prozess sein.

„Das Problem besteht darin, dass es möglicherweise ein Opfer in Brüssel gibt. Der Täter befindet sich in Kalifornien, in den USA, und der Server, der die Inhalte speichert, befindet sich vielleicht, sagen wir, in Irland.“ . Es wird also zu einem globalen Problem, weil man es mit verschiedenen Ländern zu tun hat“, erklärt Amanda Manyame.

Angesichts dieser Situation erklärt der S&D-Abgeordnete und Mitautor der neuen Richtlinie, dass „parallel zur Richtlinie getan werden muss“, die Zusammenarbeit mit anderen Ländern zu verstärken, „denn nur so können wir auch die Kriminalität bekämpfen.“ das kennt keine Grenzen.“

Auch Evin Incir gibt zu: „Leider entwickelt sich die KI-Technologie sehr schnell weiter, was bedeutet, dass auch unsere Gesetzgebung mithalten muss. Daher müssten wir die Richtlinie hier bald überarbeiten. Für den aktuellen Stand ist das ein wichtiger Schritt, aber wir.“ müssen mit der Entwicklung der KI Schritt halten.“